Inteligência Artificial e Direitos Humanos: integridade da informação, participação social e segurança pública

Em um cenário de implementação acelerada e desregulamentada, confira a atuação e contribuições da Conectas para o debate

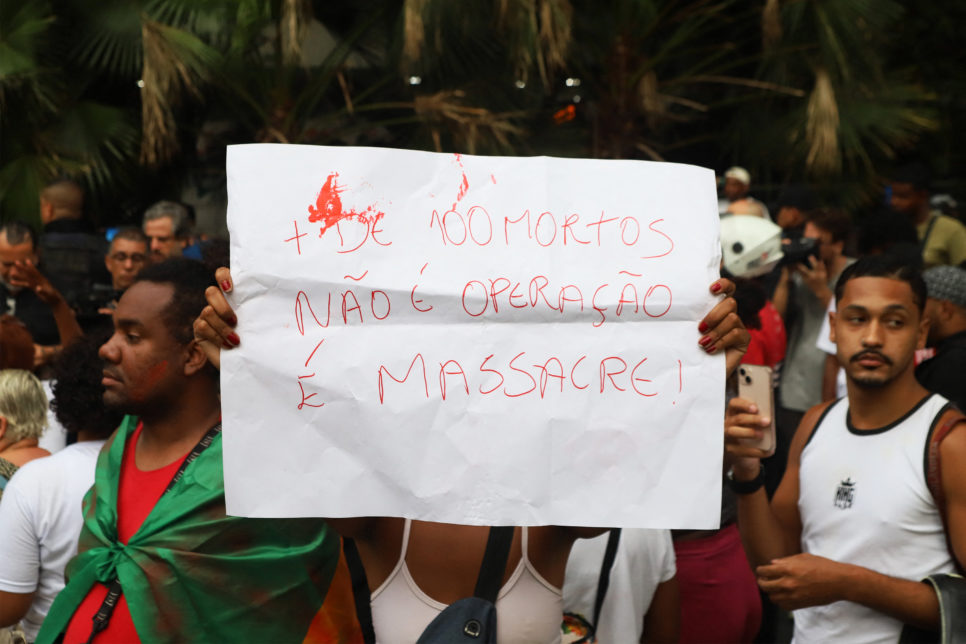

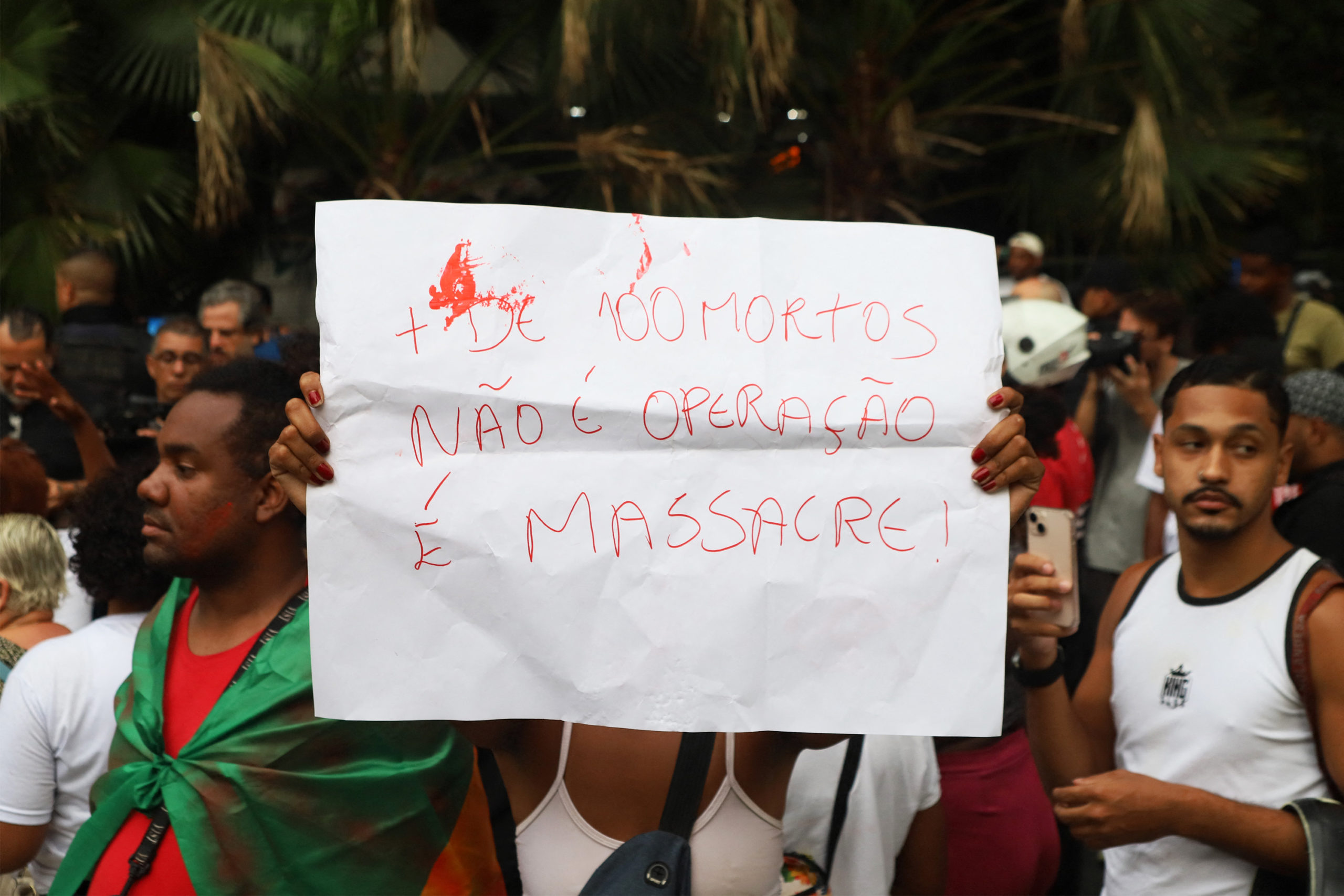

Foto: Jaque Silva / NurPhoto / NurPhoto via AFP)

Foto: Jaque Silva / NurPhoto / NurPhoto via AFP)

Com mais de 20 anos de experiência na defesa dos direitos humanos, a Conectas Direitos Humanos acompanha com atenção os impactos que a Inteligência Artificial (IA) representa para a garantia e proteção de direitos na sociedade contemporânea. A missão de proteger e expandir os direitos humanos nos impulsiona a um engajamento ativo e crítico na construção de um futuro digital e tecnológico que seja justo, equitativo e respeitoso à dignidade humana.

A crescente presença da IA em diversos setores e, no Brasil, particularmente na segurança pública e no sistema judicial, tem sido um ponto focal de nossa atuação. Em 2025, junto a organizações parceiras, a Conectas intensificou sua incidência internacional no tema, submetendo diversas contribuições a chamadas da ONU. Expressamos profunda preocupação com o uso descontrolado e sem transparência de sistemas de Reconhecimento Facial (TRF) e com o fato de que a ausência de regulação dessa tecnologia reforça vieses discriminatórios que podem causar criminalização indevida, especialmente de pessoas negras e outras populações já vulnerabilizadas.

Já em 2026, também enviamos contribuições à Comissão Interamericana de Direitos Humanos (CIDH), em um chamado sobre o impacto da inteligência artificial na região. Na ocasião, com organizações parceiras, levamos também nossas preocupações sobre os efeitos dessa tecnologia para a integridade da informação e, particularmente, para a participação de grupos historicamente vulnerabilizados na vida pública e política.

Leia mais

Destacamos a urgência de uma regulamentação que disponha sobre o uso e desenvolvimento de IA que enfatize a transparência, o controle público e o respeito aos direitos fundamentais.

O alerta sobre o Reconhecimento Facial

Junto a organizações parceiras como CESeC, LAPIN, Mães de Maio, Intervozes e Instituto da Hora, alertamos o Conselho de Direitos Humanos e diversas relatorias sobre a proliferação de sistemas de TRF no Brasil, com mais de 400 projetos ativos. A nossa principal crítica é: esses sistemas não são neutros. Eles carregam um viés racista intrínseco aos bancos de dados a partir dos quais são treinados e operados, o que causa criminalização e vulnerabilidade desproporcional para alguns grupos que já representam as principais vítimas da letalidade policial e do encarceramento em massa no país – como pessoas negras e transgêneros. A ausência de dados sobre as abordagens e detenções baseadas nessas tecnologias apenas intensifica nossa preocupação.

Diante desses desafios, defendemos a proibição do uso do reconhecimento facial na segurança pública. Porém, como o seu uso já está amplamente difundido, instamos o Poder Legislativo a, ao menos, impor regras mínimas de proteção a direitos na implementação dos sistemas e, inclusive, que sejam previstas no Projeto de Lei 2338/2023, que atualmente tramita no Congresso. Os “erros de máquina” não são meras falhas técnicas; são manifestações de vieses que resultam em prisões injustas e constrangimentos indevidos, como nos casos lamentáveis de pessoas erroneamente identificadas em espaços públicos, tais como estádios de futebol e em outros eventos culturais, mas também em unidades de atendimento de saúde.

Nossa atuação se estende também à análise dos riscos do uso de sistemas de IA no sistema judiciário. Reconhecemos avanços importantes, como a Resolução 615 do Conselho Nacional de Justiça (CNJ), que estabelece diretrizes e proíbe o uso de IA para traçar perfis criminais ou prever reincidência. Contudo, alertamos para as significativas lacunas regulatórias que ainda persistem, permitindo que governos subnacionais e empresas privadas adotem essas tecnologias e cruzem seus dados de forma opaca. A integração de sistemas de vigilância, como o “Muralha Paulista” e o “Smart Sampa”, sem avaliações de impacto ou consultas públicas adequadas, é um exemplo preocupante da expansão descontrolada de um modelo de vigilância tecnológica.

Como membro ativo da International Network of Civil Liberties Organizations (INCLO), uma rede global de 17 organizações de direitos humanos e liberdades civis, a Conectas contribuiu ainda com o Documento de Posição do Relator Especial das Nações Unidas de 2025 sobre os Impactos nos Direitos Humanos do Uso da Inteligência Artificial (IA) no Combate ao Terrorismo, que inclui orientações sobre boas práticas. Esta contribuição foi embasada em pesquisa exaustiva de membros da INCLO, traduzida para o português pela Conectas e pelo Instituto da Hora: “Olhos nos Vigilantes: Combatendo a Propagação do Reconhecimento Facial na Segurança Pública”. Junto à INCLO, a Conectas vem defendendo princípios que advogam pela proibição da TRF na segurança pública. O relatório “De Olho nos Vigilantes” é um pilar fundamental de nossa argumentação, detalhando as falhas sistêmicas, os vieses e a “toxicidade” do reconhecimento facial. Ele ressalta que, sendo inviável a proibição, que minimamente haja uma base legal clara, avaliações de impacto obrigatórias, consulta pública e a criação de um órgão de supervisão independente. Reiteramos que o resultado de uma TRF jamais deve ser a única base para qualquer ação policial, e que a transparência sobre o funcionamento dos sistemas, seus dados de treinamento e suas taxas de erro é crucial para garantir a justiça.

O impacto da IA generativa para a integridade da informação

Junto a CESeC e Aláfia Lab enviamos contribuição à Relatoria Especial para a Liberdade de Expressão da CIDHem que, além de destacarmos os desafios impostos pela crescente e desregulada implementação de sistemas de TRF na segurança pública brasileira, apontamos as questões que a IA generativa suscita para a integridade da informação e para a democracia, ao impactar a realização de eleições íntegras por facilitar fenômenos, como, por exemplo, o da violência política de gênero e raça.

No material enviado ao Relator, indicamos como a popularização desses sistemas pode intensificar a revitimização de grupos historicamente vulneráveis, como mulheres e crianças. Ademais, chamamos atenção para o fato de que o impacto do uso crescente de ferramentas de inteligência artificial para a integridade da informação tem sido cada vez mais alarmante, visto o aumento da capacidade de produção de campanhas de desinformação, bem como a perpetuação de estereótipos, o reforço da desigualdade social e a limitação do acesso a recursos e oportunidades.

Esse é um breve recorte de nossas ações e contribuições em torno do debate do uso da inteligência artificial. A Conectas permanece atenta aos desafios, defendendo um marco legal para a IA no Brasil que adote uma abordagem baseada em direitos. Nosso objetivo é garantir que a inovação tecnológica não aprofunde a exclusão, a discriminação e a falta de transparência na busca por justiça e no pleno exercício da cidadania.

Somente com articulação e incidência estratégica contínua poderemos seguir protegendo os direitos humanos diante da rápida evolução tecnológica e de seus potenciais impactos danosos. Reafirmamos o compromisso com um futuro digital no qual a tecnologia seja uma ferramenta para fortalecer, e não minar, nossa dignidade e nossos direitos fundamentais.